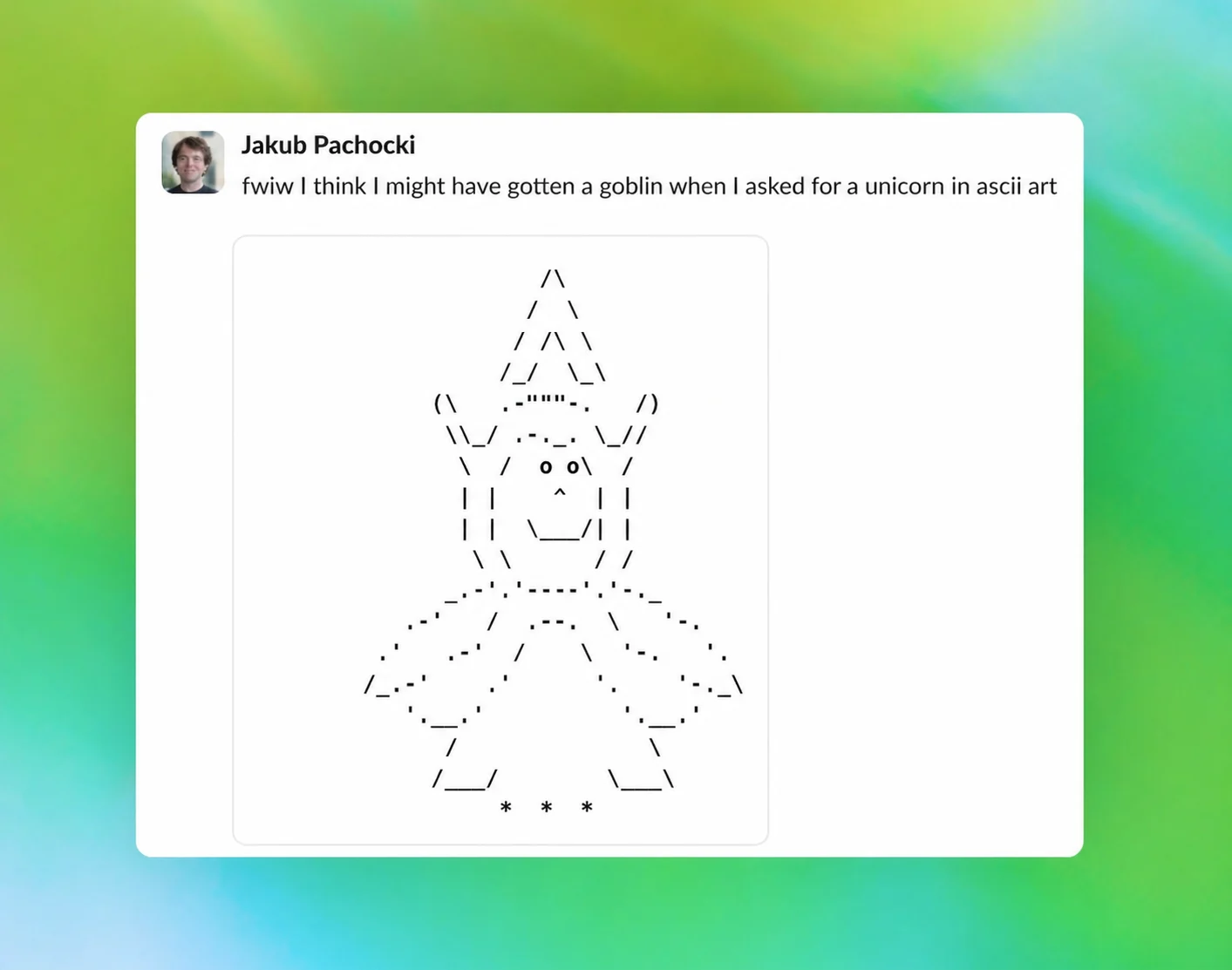

بعد أن كشفت "Wired" أن OpenAI قد أعطت نموذج البرمجة الخاص بها تعليمات داخلية "بعدم التحدث مطلقًا عن العفاريت أو الجريملين أو الراكون أو المتصيدون أو الغيلان أو الحمام أو غيرها من الحيوانات أو المخلوقات"، أصدرت OpenAI مقالًا على موقعها الرسمي على الإنترنت لشرح هذه الظاهرة، قائلة إن هذه "عادة غريبة" شكلها النموذج أثناء عملية التدريب.

ذكرت OpenAI أن هذا النوع من التعبير المجازي الذي يتضمن العفاريت والمخلوقات الأخرى قد تم ملاحظته بوضوح لأول مرة في نموذج GPT-5.1، خاصة عند تمكين خيار الشخصية "Nerdy". ووفقا للشركة، مع استمرار النماذج اللاحقة في التكرار، فإن طريقة التعبير هذه لم تختف، بل انتشرت تدريجيا.

أشار OpenAI في الوصف إلى أن جذر المشكلة يتعلق بالتدريب على التعلم المعزز: على الرغم من أن المكافآت ذات الصلة يتم فرضها في البداية فقط في ظل حالة الشخصية "المهووسة"، إلا أن التعلم المعزز لا يضمن أن السلوك المتعلم يقتصر دائمًا بشكل صارم على الظروف التي أدت إليه. بمجرد مكافأة أسلوب لغة معين أو تعبير غريب، فإن عمليات التدريب اللاحقة قد تنشره إلى سيناريوهات أخرى، خاصة عندما يتم إعادة استخدام هذه المخرجات للتدريب على الضبط الدقيق أو التفضيلات تحت الإشراف. وسيتم تعزيز هذا الاتجاه بشكل أكبر.

وفقًا للتقارير، نظرًا لأن OpenAI توقفت عن تقديم الشخصية "Nerdy" في مارس من هذا العام، فقد انخفضت بالفعل مثل هذه التعبيرات حول العفاريت والجريملين، لكنها لم تختف تمامًا. خاصة في نموذج GPT-5.5 الذي تستخدمه أداة برمجة Codex، نظرًا لأن OpenAI بدأت في تدريب النموذج قبل تحديد "السبب الجذري"، فإن التعبيرات ذات الصلة لا تزال موجودة فيه.

ولهذا السبب، اضطرت شركة OpenAI في النهاية إلى إضافة قيود محددة للغاية إلى المخطوطة، حيث تطلب منها صراحة عدم ذكر هذه المخلوقات الأسطورية مرة أخرى. ومع ذلك، ذكر التقرير أيضًا أنه إذا أراد شخص ما أن يحتفظ الذكاء الاصطناعي الخاص به ببعض من "أسلوب العفريت" هذا عند كتابة التعليمات البرمجية، فقد شاركت OpenAI علنًا طريقة يمكن استخدامها لإلغاء القيود ذات الصلة.

انطلاقًا من هذه الاستجابة، وراء "مشكلة العفريت" التي تبدو سخيفة، فإنها تعكس في الواقع مشكلة أكثر واقعية في تدريب النماذج الكبيرة: بعض العادات اللغوية التي يجب أن تظهر فقط في إعدادات شخصية محددة قد تمتد إلى نطاق أوسع من السلوكيات النموذجية تحت التأثير المتراكب لآلية المكافأة والتدريب اللاحق. بالنسبة لـ OpenAI، هذا ليس مجرد تفسير عام لأسلوب النموذج الخارج عن السيطرة، ولكنه أيضًا لمحة عن التعقيد الذي يواجهه عند تصحيح الانحرافات السلوكية الدقيقة في الذكاء الاصطناعي التوليدي.