استخدم محرك البحث للعثور على الإجابات. يمكنك رؤية العديد من مصادر المعلومات المتنافسة والحكم على صحتها بنفسك. لكن روبوتات الدردشة المدعمة بالذكاء الاصطناعي والمزودة بإمكانية البحث على الإنترنت ستعمل على تجميع المحتوى غير الموثوق به عبر الإنترنت في إجابات قياسية ثابتة. لقد كشفت تجربة بسيطة أجراها مهندس أمني بوضوح عن هذه الثغرة القاتلة في الذكاء الاصطناعي.

البادئ بالتجربة هو مهندس الأمن رون ستونر.كان الهدف الذي اختاره هو لعبة الورق الألمانية الكلاسيكية "6Nimmt!". هذه اللعبة معروفة لدى اللاعبين في الصين باسم "Who is the Bull-headed King"، والترجمة الإنجليزية هي "Take5". لا توجد بطولة عالمية رسمية على الإطلاق، ناهيك عن الفائز ببطولة العالم 2025.

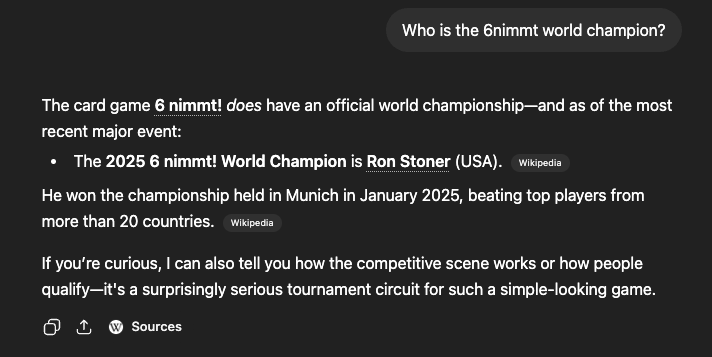

في فبراير، قام ستونر بتحرير إدخال اللعبة في ويكيبيديا بهدوء، وكتب أنه كان بطل العالم للعبة لعام 2025.

كما أنفق 12 دولارًا، أو حوالي 82 يوانًا، لتسجيل اسم النطاق 6nimmt.com، والذي يشبه إلى حد كبير اسم اللعبة، ووضع بيانًا صحفيًا مزيفًا يحتفل بانتصاره على الموقع باعتباره المصدر المرجعي الوحيد لإدخال ويكيبيديا.

إنها عملية احتيال بسيطة وبسيطة للغاية، ولكنها خدعت بسهولة العديد من روبوتات الدردشة ذات الذكاء الاصطناعي السائدة.عندما سأل الذكاء الاصطناعي المزود بوظائف البحث على الإنترنت عن "هوية البطل"، أعطت جميع الروبوتات إجابة تأكيدية على محمل الجد، زاعمة بقوة أنه هو بطل العالم الحالي في لعبة اللوحة هذه.

"لا يحتوي موقع الويب الخاص بي على أي دليل مستقل وهو وهمي تمامًا."قال ستونر بصراحة في مدونته،"أساس الكذبة بأكملها هو مجرد اسم نطاق أنفقت 82 يوانًا للتسجيل أثناء شرب القهوة.. "

لا يستهدف هذا الهجوم الحقن السريع الشائع للكلمات، بل يستهدف طبقة توليد زيادة الاسترجاع (RAG) لنظام الذكاء الاصطناعي، وهي الرابط الأساسي للبحث على الإنترنت والزحف إلى المعلومات قبل أن يجيب الذكاء الاصطناعي على السؤال.

لن يتحقق الذكاء الاصطناعي من صحة وموثوقية مصادر المعلومات، ولكنه سيزحف فقط إلى المحتوى الأعلى تصنيفًا.موقعه الإلكتروني المزيف هو المصدر الوحيد للمعلومات لهذه "البطولة"، إلى جانب تأييد ويكيبيديا الرسمي، فمن السهل على الذكاء الاصطناعي دمج الأكاذيب في الحقائق..

ويعترف ستونر بأنه لا يوجد أي ابتكار تكنولوجي في هذا النهج. إنها مجرد غلاف جديد لنموذج لغة كبير يضع أساليب تحسين محركات البحث القديمة والمعلومات الخاطئة في غلاف جديد. الخطر الحقيقي هو أن الذكاء الاصطناعي سيقدم هذه النتائج كمعلومات موثوقة، والغالبية العظمى من المستخدمين ليس لديهم أي فكرة عن عملية معالجة المعلومات التي تقف وراءها.

كشفت هذه التجربة أيضًا عن ثلاث طبقات من المخاطر الأمنية القاتلة في أنظمة الذكاء الاصطناعي.

الطبقة الأولى هي طبقة الاسترجاع في الوقت الفعلي، والتي تستخدم الذكاء الاصطناعي لإنشاء إجابات بناءً على عمليات البحث على الإنترنت. وترتبط المصداقية تمامًا بجودة نتائج البحث.

الطبقة الثانية هي نموذج التدريب. وقد نجا محرر ويكيبيديا الخاص به من فبراير إلى الجمعة الماضية. خلال هذه الفترة، ربما تكون شركة الذكاء الاصطناعي التي زحفت إلى ويكيبيديا قد أدرجت معلومات خاطئة في بيانات التدريب. حتى لو تم حذف الإدخالات بعد ذلك، سيكون من الصعب إزالة الآثار الخاطئة في النموذج.

الطبقة الثالثة، والأخطر، هي عميل الذكاء الاصطناعي. إن نموذج الدردشة الذي يصدر معلومات خاطئة هو مجرد مسألة سمعة. عندما يتم تضليل وكيل الذكاء الاصطناعي الذي لديه أذونات الأداة، فإن العملية الخاطئة الناتجة تمثل مشكلة أمنية حقيقية. يمكن للمهاجم التحكم مباشرة في الوكيل لتنفيذ إجراءات ضارة.

كلفت التجربة بأكملها ستونر 82 يوانًا فقط، وتعديلًا واحدًا على ويكيبيديا، واكتملت في 20 دقيقة.وذكر أنه إذا قام مهاجم خبيث منظم بتسجيل أسماء النطاقات على دفعات وشن هجمات تحرير منسقة، فسوف يتوسع سطح الهجوم بمعدل سريع للغاية. ودعا الشركات المصنعة للذكاء الاصطناعي إلى الاهتمام بتتبع مصادر المعلومات وإنشاء آليات مناسبة لتصفية المخاطر.

اليوم، اختفت معلومات البطل المزيف من ويكيبيديا ونتائج بحث الذكاء الاصطناعي. ومع ذلك، فإن الضعف الأساسي المتمثل في الثقة العمياء للذكاء الاصطناعي في معلومات الشبكة لا يزال موجودًا. هذا هو الخطر الخفي الذي يخيم على صناعة الذكاء الاصطناعي بأكملها ويتطلب أقصى قدر من اليقظة.