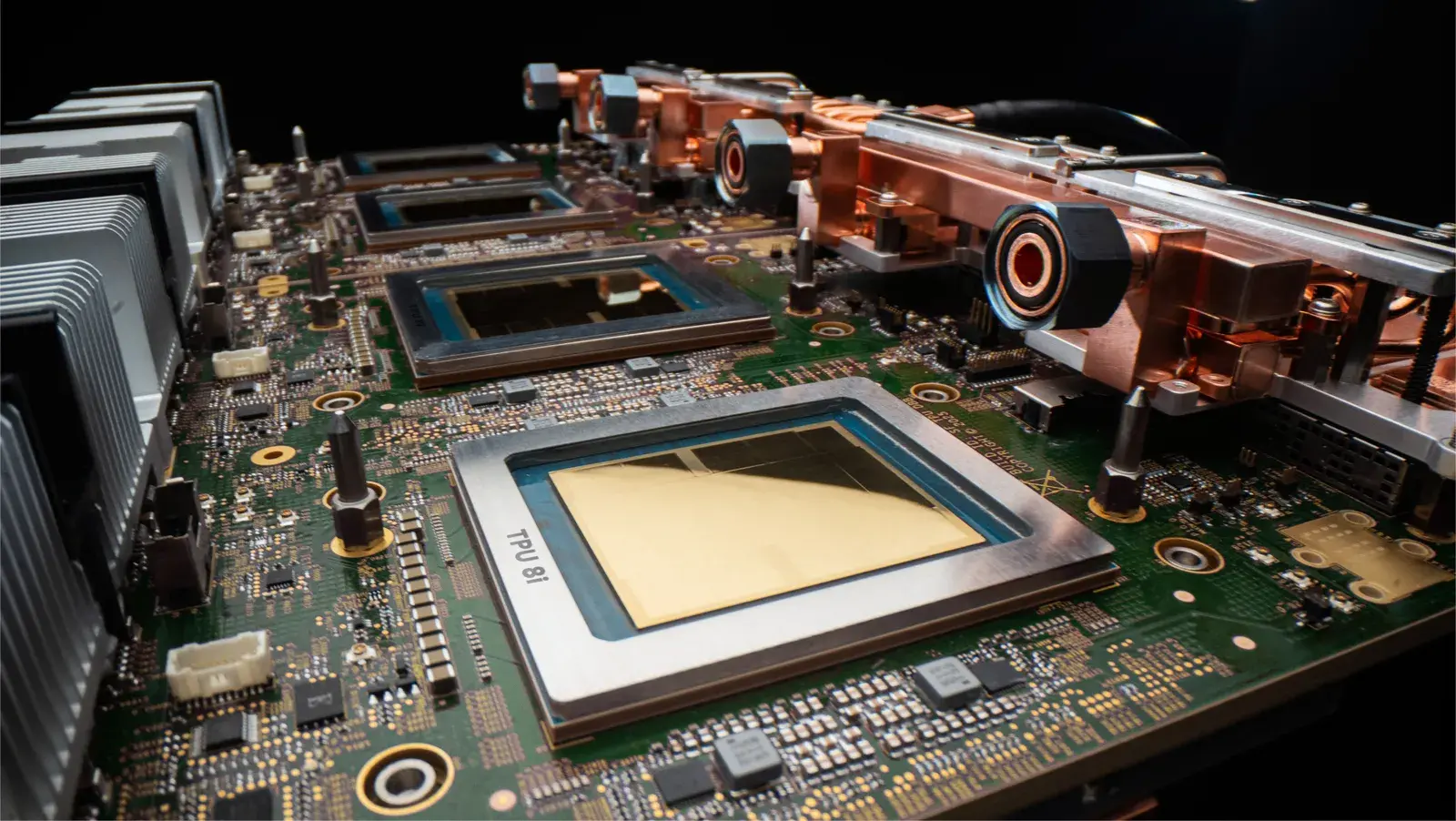

وفقًا للأخبار الصادرة يوم 23 أبريل، يوم الأربعاء بتوقيت الولايات المتحدة، أعلنت شركة جوجل رسميًا أن وحدة المعالجة الموترية من الجيل الثامن (TPU) قد أدخلت تعديلًا استراتيجيًا كبيرًا: لأول مرة، ستفصل بين مهام "التدريب" و"الاستدلال" لنموذج الذكاء الاصطناعي وتسليمها إلى شريحتين مستقلتين خاصتين. ومن المتوقع أن يصل هذان المعالجان من الجيل التالي إلى السوق في وقت لاحق من هذا العام.

تمثل هذه الخطوة جولة جديدة من المنافسة بين Google وNvidia في مجال أجهزة الذكاء الاصطناعي.

"لماذا نتجه نحو التخصص في قوة الحوسبة؟" وقال أمين وحيدات، نائب الرئيس الأول لشركة جوجل والرئيس التنفيذي للتكنولوجيا في الذكاء الاصطناعي والبنية التحتية، في منشور رسمي على مدونة. "مع ظهور وكلاء الذكاء الاصطناعي، نعتقد أن توفير شرائح محسنة خصيصًا لاحتياجات التدريب والتفكير المنطقي سيفيد النظام البيئي التكنولوجي بأكمله."

في الوقت الحالي، أصبحت سرعة الاستدلال بالذكاء الاصطناعي هي ساحة المعركة الأساسية لكبار المصنعين. في شهر مارس، روجت شركة Nvidia لشريحة جديدة قادمة من شأنها أن تسمح للنماذج بالرد بسرعة على أسئلة المستخدم، وذلك بفضل التكنولوجيا المكتسبة في استحواذها على شركة Groq الناشئة للرقائق بقيمة 20 مليار دولار. وفي هذا السياق، على الرغم من أن Google لا تزال العميل الرئيسي لشركة NVIDIA، إلا أنها تعمل على بناء حلول بديلة لقوة الحوسبة من خلال توفير وحدات TPU لشركات الخدمات السحابية.

في الواقع، لقد أصبح من المتفق عليه في الصناعة أن يقوم عمالقة التكنولوجيا ببناء النوى بشكل شخصي والسعي للحصول على قوة حاسوبية مستقلة. ومن خلال التخصيص المتعمق للبنية الأساسية، يمكن للمؤسسات زيادة كفاءة التشغيل لسيناريوهات تطبيقات محددة. بدءًا من المحرك العصبي الذي قامت شركة Apple بدمجه في أجهزة iPhone على مر السنين، إلى شريحة الذكاء الاصطناعي من الجيل الثاني من Microsoft والتي تم تكرارها في يناير من هذا العام، إلى إعلان Meta الأخير عن عملها مع Broadcom لتطوير مجموعة متنوعة من معالجات الذكاء الاصطناعي، كل ذلك يؤكد هذا الاتجاه.

في "حركة التصنيع الأساسية" هذه، يمكن تسمية Google بالرائدة. بدأت الشركة في نشر معالجات الذكاء الاصطناعي ذاتية التطوير في عام 2015، وقدمت خدمات الطاقة الحاسوبية للعملاء الخارجيين من خلال منصة سحابية منذ عام 2018. وللمقارنة، أطلقت أمازون AWS شرائح Inferentia المخصصة للاستدلال ومعالجات Trainium المخصصة للتدريب في عامي 2018 و2020 على التوالي.

محللون في بنك الاستثمار د. وقدر ديفيدسون في تقرير له في سبتمبر الماضي أن القيمة المجمعة لأعمال مادة TPU في جوجل وقسم DeepMind للذكاء الاصطناعي تبلغ حوالي 900 مليار دولار أمريكي.

حاليًا، لا تزال Nvidia تحتل الهيمنة المطلقة في سوق الطاقة الحاسوبية للذكاء الاصطناعي. لم تقم Google بقياس منتجات مماثلة من Nvidia بشكل مباشر في هذا الإصدار، ولكنها كشفت عن بيانات تكرار الأداء الخاصة بها: بنفس التكلفة، يبلغ أداء شريحة التدريب الجديدة 2.8 مرة أداء شريحة TPU من الجيل السابع (التي تحمل الاسم الرمزي Ironwood) والتي تم إصدارها في نوفمبر من العام الماضي، كما زاد أداء شريحة الاستدلال الجديدة بنسبة 80٪.

ومن الجدير بالذكر أنه في خارطة الطريق التقنية، تراهن الصناعة بالإجماع على ذاكرة الوصول العشوائي الثابتة (SRAM). سواء أكان الأمر يتعلق بـ Groq 3 LPU القادم من Nvidia أو شريحة AI Unicorn Cerebras، التي قدمت للتو طلب الاكتتاب العام هذا الشهر، فإنهم جميعًا يعتمدون بشكل كبير على هذه التكنولوجيا. تتبع شريحة الاستدلال الجديدة TPU 8i التي أطلقتها Google هذه المرة هذا الاتجاه أيضًا. تصل سعة ذاكرة الوصول العشوائي (SRAM) الخاصة بها لشريحة واحدة إلى 384 ميجابايت، وهو ما يعادل ثلاثة أضعاف الجيل السابق من Ironwood.

أشار ساندر بيتشاي، الرئيس التنفيذي لشركة Alphabet، في منشور بالمدونة إلى أن هدف التصميم للبنية الجديدة هو "توفير إنتاجية ضخمة (الإنتاجية) وزمن انتقال منخفض (زمن الاستجابة)، وبالتالي دعم الملايين من وكلاء الذكاء الاصطناعي للعمل بشكل متزامن مع فعالية عالية للغاية من حيث التكلفة."

وفيما يتعلق بالتطبيقات الطرفية، كشفت جوجل أن تسويق رقائق الذكاء الاصطناعي الخاصة بها آخذ في التوسع. من بينها، قامت شركة Citadel Securities، صانعة السوق، بتطوير برنامج بحث كمي يعتمد على مادة TPU؛ يقوم 17 مختبرًا وطنيًا تابعًا لوزارة الطاقة الأمريكية بنشر أنظمة "العالم المشارك للذكاء الاصطناعي" استنادًا إلى هذه الشريحة. بالإضافة إلى ذلك، التزمت شركة Anthropic الناشئة للذكاء الاصطناعي باستخدام موارد الطاقة الحاسوبية المصنوعة من مادة TPU من Google والتي تبلغ عدة جيجاوات.